NPU(Neural Processing Unit)は、AI処理に特化したプロセッサであり、ディープラーニングや機械学習のアルゴリズムを高速かつ効率的に処理するために設計されています。

近年、AI技術は私たちの生活に急速に浸透してきています。

スマートフォンの顔認識、自動運転車の障害物検知、さらには工場の自動化やスマート家電まで、あらゆる分野でAIの力が活用されています。こうしたAI処理を支える中核技術のひとつが「NPU」です。

AIアルゴリズムの高速・高効率な処理を可能にするAI専用のプロセッサで、その特化性ゆえに、従来のCPUやGPUでは実現が難しかった処理能力や電力効率を実現し、AIの実用化を大きく後押ししています。

本記事では、AI社会を支える縁の下の力持ち「NPU」に焦点を当て、その特徴やCPU・GPUとの違い、そして実際の活用事例を通じて、その重要性をわかりやすく解説していきます。

- NPUはAI処理に特化した高効率なプロセッサ

- スマホや自動運転など多様なAI用途で活用

- CPU・GPUよりも低消費電力かつ高速処理が可能

- AI推論処理に特化し、学習処理は非対応

CPUのメーカーや型番の見方、性能の目安などの基本知識、性能面や互換性の観点から選び方も解説しています。

≫ 関連記事:自作PCのCPUの選び方【性能面 / 機能面 / 互換性】

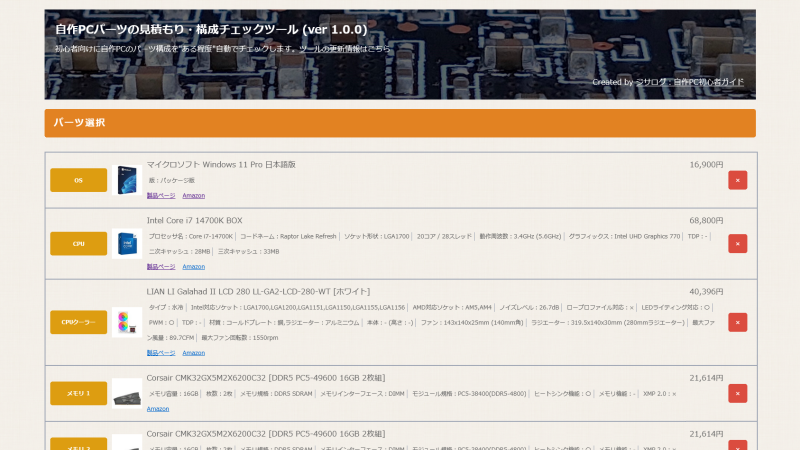

PCパーツと通販サイトを選ぶだけで、見積もり、互換性チェック、電源容量計算ができるツールも開発したのでぜひ活用してください。 最大5つの構成を保存できるので色々な構成を試せます。

≫ ツール:自作PCパーツの見積もり・互換性チェックツール

NPUとは?

まずは、NPUの基本的な知識とCPUやGPUとの違いについて解説していきます。

AI処理に特化したプロセッサ

NPU(Neural Processing Unit)は、AI処理に特化したプロセッサで、人工知能(AI)の計算を効率的に行うために設計されています。

NPUは、ディープラーニングや機械学習といったAIの処理を高速に実行することができ、特に画像認識や音声認識といったタスクでその性能を発揮します。

従来のCPUやGPUと比べて、NPUはAIの計算に特化したアーキテクチャを持っており、電力効率が高く、より少ないエネルギーで大量のデータを処理することが可能です。

これにより、スマートフォンや自動運転車、IoTデバイスなど、さまざまな分野でのAIの活用が進んでいます。

NPUの役割と重要性

NPUは、近年、AI技術が私たちの生活に急速に浸透してきた影響もあり、その役割と重要性はますます高まっています。

自動運転車の障害物検知、工場の自動化やスマート家電まで、あらゆる分野でAIの力が活用されています。

また、個人が利用する分野で言うとスマートフォンの顔認識、ChatGPTなどの生成AI、スマホやパソコンに搭載されたアシスタントAIなどです。

ChatGPTでは、実際の処理はサーバー側で行っているので、スマホやパソコンといったデバイス側でAIの処理をすることはありませんが、次の観点からデバイス側でもAIの処理をする需要が高まっています。

- プライバシー保護

個人の音声、映像、操作履歴などをクラウドに送らずに処理できる。

機密性の高い情報を扱う企業用途や個人情報保護の観点で重要 - 通信が不要/オフラインでも動作可能

インターネット接続なしでもAIが機能(例:音声認識、画像分類)

移動中や電波の弱い環境でも安定して利用できる。 - 低遅延でリアルタイム処理が可能

デバイス内で即時処理されるため、クラウド経由よりも応答速度が早い。

例:ビデオ会議の背景ぼかし、音声アシスタントの即応答、リアルタイム字幕など。 - 通信コストの削減

毎回クラウドとやり取りする必要がないため、モバイルデータや通信料金の節約につながる。

事業者側にとっても通信コストが大幅に減る。 - サーバーの負荷軽減/スケーラビリティ向上

ユーザーごとの推論処理を端末側で完結できれば、クラウド側のリソース消費が減る。

サービス提供者にとっても大規模展開しやすい。

こうした理由からデバイス側でもAIの処理を効率的に行えることが、今後のさらなるAIの普及には必要不可欠となっています。

従来のCPUやGPUと比べて、NPUは、AIを処理する際によく使うニューラルネットワークの計算に最適化されており、特にディープラーニングの推論処理において優れた性能を発揮します。

推論処理とは、学習済みのAIモデルを使って、入力データに対して予測や分類などの結果を出す処理のことです。

AIを活用するには、まず膨大なデータを用いて「学習(トレーニング)」を行い、学習済みのAIモデルを作成する必要があります。

しかし、この学習処理には非常に高い演算性能(※)が求められるため、スマホやパソコンに搭載されるNPUでは対応できません。

そのため、NPUは、学習済みモデルを使った推論処理に特化したプロセッサです。

※非常に高い演算性能とは、1台200~300万する高性能GPUを数千~数万台レベル(企業が行うAIの学習の一般的な規模感)です。

![]() ケンさん

ケンさん

これにより、スマートフォンや自動運転車、スマートホームデバイスなど、さまざまなデバイスでリアルタイムにAI機能を活用することが可能になります。

NPUとCPUの違い

NPUとCPUは、どちらもコンピュータの処理装置ですが、その役割と設計思想には大きな違いがあります。

CPUは、一般的な計算処理を行うための汎用的なプロセッサで、プログラムの命令を順次実行することに優れています。

OSの管理やアプリケーションの実行など、幅広いタスクをこなすことができますが、AIのような特定の計算処理においては、NPUほどの効率は発揮できません。

一方で、NPUは、特にAIのタスクを効率的に処理するために設計された専用のプロセッサです。

様々なAIで使われるニューラルネットワークの計算に特化しており、大量のデータを並列に処理する能力があります。

例えば、色々な仕事を平均的にこなす人(CPU)と特定の仕事はめちゃくちゃ早くて質も高い人(NPU)という感じで、どちらにもメリット・デメリットはあって、適材適所ということをイメージしてもらうと分かりやすいと思います。

NPUにより、AIモデルの推論を高速に行うことができ、特に画像認識や自然言語処理(音声アシスタント、機械翻訳、チャットボット)といった分野での性能向上が期待されます。

NPUは、CPU内に組み込まれていることが多いですが、実際にはCPUとは別のユニットとして設計されています。

IntelやAMDのCPUでは、公式ページの仕様にNPUが書かれてるので、CPUの一部と捉えられるかもしれません。

実際、物理的にはPCパーツのCPUの中にあるのですが、演算ユニットとしてはCPUとNPUは別物ですね。

このように、NPUとCPUはそれぞれの得意分野で異なる役割を果たしており、AIの進化に伴い、NPUの重要性が増しています。

NPUとGPUの違い

こちらもCPUと同様ですが、NPUとGPUも役割と設計思想には大きな違いがあります。

GPUは、もともとグラフィックス描画のために開発されたプロセッサです。

多数の演算ユニット(コア)を搭載し、画像処理や映像レンダリングのような同時並列演算に非常に強いのが特徴です。

この並列処理の特性が、AIの学習や推論における膨大な行列演算とも相性が良く、現在ではAI用途でも広く使われています。

GPUは柔軟性が高く、AIだけでなく科学技術計算、シミュレーション、動画編集などにも使える汎用性のある並列演算プロセッサです。

一方、NPUは、AI処理の中でも特にニューラルネットワークの推論に特化した専用プロセッサです。

GPUのような汎用性はありませんが、特定のAI処理(推論)に限れば、より高速・省電力に実行できるように最適化されています。

特に、スマートフォンやノートPCなどの省電力デバイスでは、GPUよりも効率的にAI機能を活用できるのがNPUの強みです。

NPUのメリット

NPUを搭載することで何がいいのか、メリットについて解説していきます。

AI処理の高速化・省電力

通常のCPUやGPUと比べて、NPUはニューラルネットワークの演算に最適化されており、並列処理能力が高いため、大量のデータを迅速に処理することができます。

これにより、リアルタイムでのデータ処理や、より複雑なモデルの使用が可能となり、AIの応答速度が向上します。

さらに、NPUは電力効率が高いため、CPUやGPUで同じ計算を行う場合でも消費電力を抑えることができます。

そのため、消費電力を抑えながら高いパフォーマンスを維持できるため、バッテリーの駆動時間を意識しなければいけないモバイルデバイスや組み込みシステムでも利用が進んでいます。

CPU・GPUの負荷軽減

NPUは、AI処理に特化した設計がされているため、CPUやGPUの負荷を軽減することができます。

通常、CPUやGPUは汎用的な計算を行うために設計されていますが、AIの処理には大量の行列計算やベクトル演算が必要です。

これらの計算はNPUが得意とするところで、NPUがあることで、CPUやGPUは他のタスクに専念でき、全体的なシステムの効率が向上します。

ローカル環境で完結(プライバシー / セキュリティ / ネット経由が不要)

NPUは、デバイス内で直接データ処理を行うため、クラウドにデータを送信する必要がありません。

ローカルで完結することで、サーバー側に入力データが送信されないため、プライバシーが保たれ、セキュリティリスクが低減します。

また、インターネットが不安定な環境でも安定して動作します。

個人情報や企業の機密情報などの入力データを見られる可能性があることが問題視されていますが、ローカルで処理すればサーバーに入力データを送信する必要がないため、基本的に見られることはありません。

しかし、NPUを搭載して、ローカルで処理しているから100%安全と考えるのは適切ではありません。

なぜなら、ローカルでNPUを使ってAI処理をするとは別に、その前後で別途サーバーに送信することがアプリケーションの設計次第では可能だからです。

つまり、「元々サーバー側でするので必然的に入力データがサーバーに送信される」という状態から、ローカルで処理することで「やろうと思えば入力データをサーバー側に送信することができる」という状態に変わっただけです。

事業者やアプリケーションの設計次第では入力データが送られる可能性があるので、そういう意味では、プライバシーやセキュリティリスクが100%安全とは言い切れません。

そのため、プライバシーとセキュリティリスクの観点から言うと、NPUを搭載されたことによりローカルでAI処理をするかどうかにかかわらず、AIを使う際には利用規約等を確認して、入力データが収集されているのかどうかのチェック、また、利用しないと書かれていても信用できなさそうであれば使わないということは考えるようにしましょう。

また、サーバーへの依存がないため、インターネット接続が不安定な環境でも安定して動作します。

データの送受信が不要になることで、処理速度が向上し、リアルタイムでの応答が可能になります。

【事業者目線】サーバーリソース、通信・電力コストの削減

サーバーを介して処理をしているAIサービスの場合、事業者側は、サーバーリソースや通信コスト、電力コストがかかります。

生成AIとして有名な「ChatGPT」では現在世界で4億人に使われているようですが、この膨大な人数のリクエストに応えるためには、高性能かつ膨大な数のサーバーが必要になってきますし、サーバーにアクセスして処理する度、通信コストや電力コストが必要となってきます。

NPUが搭載されてローカルでAI処理ができるようになれば、これらのコストを大幅に削減することが可能になります。

また、サーバー側での処理が不要または軽減されることで、スケーラビリティが向上します。

スケーラビリティとは、システムやサービスが、負荷や需要の増加に応じて、性能や規模を効率的に拡張できる能力のことを言います。

つまり、利用者が10倍、100倍に増えても耐えられやすくなったり、必要に応じてリソースを柔軟に増やしやすくなったりということが可能となります。

NPUのデメリット

NPUを搭載することのデメリットについて解説していきます。

【事業者目線】アプリケーション側の対応が必要

ユーザー視点というより、主に事業者側のデメリットですが、アプリケーション側の対応が必要という点です。

NPUは特定の計算を高速に処理するために設計されていますが、その性能を最大限に引き出すためには、専用のアプリケーションやドライバが必要です。

一般的なCPUやGPUとは異なり、NPUはニューラルネットワークの処理に特化しているため、既存のアプリがそのままではうまく動作しないことがあります。

開発者は、NPUに最適化されたアプリを開発する必要があり、これには追加の時間と労力がかかります。

また、NPUを効果的に利用するためには、開発者がNPUのアーキテクチャや特性を理解し、それに合わせたプログラミングを行う必要があります。

アプリ側で、NPUに適した処理なのか、NPUが搭載されているパソコンかを判断した上で、NPUに処理を任せるというプロセスになります。

このように、NPUを導入する際には、ハードウェアだけでなくアプリの対応も考慮する必要があります。

ユーザー視点から言うと、NPUを搭載したパソコンを使い始めたからといって、自動的にAIに向いている処理がNPUで処理されるかといわれるとそのようなことはありません。

また、NPUが搭載されていなかったり、アプリ側が対応していない場合は、今まで通りCPUで処理されるので安心してください。

「せっかくNPU搭載のパソコンを使ってるのに、アプリ側で対応していないから処理の効率が良くないか…」というちょっと損した気持ちになるだけで、アプリが動作しなかったり、不安定になることはありません。

その場合は、将来的にアップデートでNPUに対応される可能性もあるので期待して待ちましょう。

NPUが得意とする処理の具体例

NPUについて役割やメリットなどを解説してきましたが、NPUがどういう処理に向いているのか、その例を見ていきましょう。

解説内では、具体的なアプリケーション名や「この機能はあのアプリのものだな…」とイメージできる表現が含まれることがありますが、それはあくまで「NPUに向いている処理の一例」として挙げているものです。

実際に、そのアプリケーションや機能がNPUに対応しているかどうかを保証するものではありません。

あくまで「こういった種類の処理が、技術的にNPUと相性が良い」という観点からの説明であることを、前提としてご理解のうえ、お読みください。

ビデオ会議におけるリアルタイムなAI処理

NPUは、リアルタイムに大量のデータを並列処理する能力に優れており、ビデオ会議のような映像・音声処理を含むAIタスクでその強みを発揮します。

背景ぼかし・仮想背景合成

ビデオ会議では、参加者の顔を検出し、背景をぼかしたり、仮想の背景に置き換えたりする機能がよく使われます。

これらの処理は、人物と背景をリアルタイムで識別・分離し、それぞれに異なる処理を加える必要があり、ニューラルネットワークによる画像認識がベースになっています。

このような高負荷な画像推論処理は、NPUが得意とする領域であり、CPUやGPUよりも低遅延・省電力で実行できるため、バッテリー駆動のノートPCなどでも快適な体験が可能になります。

音声ノイズキャンセル・エコー除去

リアルタイムで周囲の雑音を抑えたり、反響音を除去したりするノイズキャンセルやエコー除去も、機械学習を用いた処理が多く、NPUで効率的に実行できます。

アクティブノイズキャンセリング(ANC)では、マイクで環境音を拾い、それを打ち消す音波を生成しますが、これもNPUがリアルタイムで計算することで実現することができます。

顔の自動フレーミング・目線補正

NPUは、カメラ映像内で顔をリアルタイムに認識・追跡する処理も得意です。

たとえば、「顔の自動フレーミング」は、被写体が移動しても画面の中心に収まるように自動的にフレームを調整する技術ですが、これには継続的な顔認識と位置予測が必要です。

また、「目線補正」では、ユーザーが画面を見ていても、あたかもカメラを見て話しているように目線を補正します。

これも画像の構造理解と補正が求められ、深層学習ベースの処理がNPUによってスムーズに実行されます。

Windows Copilot や AIアシスタントの処理

Windows CopilotやAIアシスタントのような機能では、ユーザーの音声入力や自然言語による指示をリアルタイムで処理する必要があります。

これらの処理には、音声認識・自然言語理解・応答生成といった複雑なAIタスクが含まれており、NPUは、その推論処理を効率的に実行することができます。

NPUは、ニューラルネットワークによる推論処理に特化しており、CPUやGPUよりも低消費電力で高速な実行が可能です。

これにより、例えば以下のようなAIアシスタントの動作が快適になります

- 「OK、グーグル!」といった音声での呼びかけ(ウェイクワード)検出

- 質問の意味解析と回答候補の生成

- 操作コマンドのリアルタイム実行(例:「明日の予定は?」)

さらに、NPUは、デバイス内で処理を完結できるため、通信の遅延が少なくなり、快適なAI体験を実現しやすくなります。

また、バッテリー駆動が求められるスマホやノートPCなどでは、高性能を保ちつつ電力消費を抑えられるNPUの存在は重要です。

このように、Windows CopilotやAIアシスタントのような“継続的かつ軽量なAI処理”には、NPUが非常に適していると言えます。

カメラの自動補正・顔認識

NPUは、リアルタイム画像処理を効率的に行うAI専用プロセッサとして、カメラ機能の高度化に大きく貢献しています。

特に、スマホなどの撮影・映像機能を備えたデバイスでは、NPUがカメラの裏側で多くのAI処理を担っています。

自動補正:より美しい写真をリアルタイムで実現

撮影時に、カメラは明るさ・コントラスト・ホワイトバランス・肌のトーンなどを自動で調整します。

これらの処理は従来は静的なアルゴリズムで行われていましたが、現在ではNPUによって、画像をリアルタイムに解析・最適化するAI補正が可能になりました。

- 顔やシーンを認識して最適な露出に調整

- 空や植物などの被写体に合わせて色味を補正

- 肌補正や美肌処理などもAIによって自動適用

これらはすべて、ニューラルネットワークモデルの推論処理によって実現されており、NPUがそれを低遅延・省電力で実行します。

顔認識:高速・高精度な処理で撮影体験を強化

顔認識も、NPUが特に得意とする処理の一つです。

撮影中にNPUが映像をリアルタイム解析し、被写体の顔を素早く検出することで、次のような高度な撮影機能が、誰でも簡単に使える形で実現しています。

- 自動でフォーカスを顔に合わせる

- 複数人の顔を認識し、全体の構図を最適化

- 背景ぼかしやポートレートモードを自然に適用

セキュリティ機能の強化

NPUは、AI処理に特化したプロセッサとして、セキュリティ分野においても重要な役割を果たしています。

特に、リアルタイムでのデータ解析や異常検出など、従来のプロセッサでは負荷が大きかった処理を効率的に実行できる点が特長です。

異常検知・不正アクセスのリアルタイム分析

セキュリティシステムでは、ログや通信データをリアルタイムに監視し、通常とは異なる挙動をいち早く察知することが求められます。

NPUは、機械学習によるパターン認識を高速・低消費電力で行えるため、こうした異常検知アルゴリズムを端末側で常時動作させることが可能になります。

これにより、サイバー攻撃の兆候やマルウェアによる挙動を素早く検出し、被害の未然防止や迅速な対処を実現することができます。

より高度で堅牢なセキュリティ環境の実現

NPUの導入によって、セキュリティシステムは単なる“監視ツール”から“リアルタイムで自己判断・対応するAIベースの防御システム”へと進化します。

これは、特にエンドポイント(PC・スマートフォンなど)において、サーバーに頼らずとも高レベルな保護を提供できるという意味でも重要です。

バッテリー効率の最適化

NPUを導入することで、CPUやGPUよりも効率的に処理することでエネルギー効率が上がるため、バッテリーもより長持ちします。

これはNPU自体の特性ですが、この他にも、NPUを活用したAIによる”バッテリーの使い方自体(バッテリーマネジメントシステム)を最適化”する取り組みもあります。

従来の固定的な電力管理に代わり、次のように動的でユーザー毎に最適化したマネジメントが実現されつつあります。

- ユーザーの使用傾向を学習し、バックグラウンド処理や通知を最適化

ユーザーが使わない時間帯やアプリをAIが学習し、不要なアプリのバックグラウンド動作や通知を自動的に抑制することで、無駄な電力消費を削減します。 - 時間帯や行動パターンに応じてアプリの電力配分を自動調整

朝・昼・夜などの使用傾向に合わせて、よく使うアプリに優先的に電力を割り当て、他は省電力モードに切り替えることで効率化を図ります。

- バッテリー温度や充電履歴に基づく充電スケジュール最適化(バッテリー寿命延長)

高温時の充電を避けたり、ユーザーが充電完了前に使い始めるタイミングを学習して80〜90%までで止めるなど、バッテリー劣化を防ぐ最適な充電制御を行います。

これらの判断や予測処理はAIモデルによって行われ、ローカルでの推論にはNPUが活用されます。

そのため、常時稼働していても消費電力は抑えられ、静かにバッテリー全体の効率を底上げする仕組みを実現することができます。

自動翻訳・字幕生成

自動翻訳や字幕生成といった言語処理系のAIタスクは、大量のテキストと音声データをリアルタイムで処理する必要がある高度な演算処理です。

NPUは、音声認識・自然言語処理・機械翻訳といった処理を並列かつ高速に実行できるため、リアルタイム性が求められる自動字幕生成や翻訳機能に最適です。

例えば、動画視聴中に話されている内容を即座に文字起こしし、それをユーザーの言語に翻訳して字幕として表示するといった処理は、NPUによってCPUやGPUに比べてはるかに低遅延・省電力で実現されます。

まとめ:NPUはAI時代の”頭脳”

NPU(Neural Processing Unit)の特徴や役割、CPUやGPUとの違い、NPUが得意とする処理について解説しました。

改めて重要なポイントをまとめておきます。

- NPUはAI処理に特化した高効率なプロセッサ

- スマホや自動運転など多様なAI用途で活用

- CPU・GPUよりも低消費電力かつ高速処理が可能

- AI推論処理に特化し、学習処理は非対応

NPUは、AI処理に特化したプロセッサとして、私たちの生活に深く関わるさまざまなデバイスの“頭脳”として機能しています。

ディープラーニングや機械学習といった複雑なAI処理を高速かつ省電力で実行できるNPUは、スマホやパソコン向けのCPUに組み込まれ、あらゆる分野でその力を発揮しています。

それでもなお、今後ますます進化し続けるAI社会において、NPUは欠かせない技術になることでしょう。

そのため、CPUなどのメーカーはNPUに力を入れていくので、今後さらなる性能アップ、そして、デバイスでできることが増えてくると思います。

まさに、NPUはAI時代を支える頭脳というわけです。

CPUのメーカーや型番の見方、性能の目安などの基本知識、性能面や互換性の観点から選び方も解説しています。

≫ 関連記事:自作PCのCPUの選び方【性能面 / 機能面 / 互換性】

PCパーツと通販サイトを選ぶだけで、見積もり、互換性チェック、電源容量計算ができるツールも開発したのでぜひ活用してください。 最大5つの構成を保存できるので色々な構成を試せます。

≫ ツール:自作PCパーツの見積もり・互換性チェックツール

ジサログ:自作PC初心者ガイド

ジサログ:自作PC初心者ガイド